LLMS, agentes, ferramentas e estruturas

A inteligência synthetic generativa (Genai) está cheia de conceitos e termos técnicos; Alguns termos que frequentemente encontramos são grandes modelos de idiomas (LLMS), agentes de IA e sistemas agênticos. Embora relacionados, eles servem a propósitos diferentes (mas relacionados) dentro do ecossistema de IA.

Os LLMs são os mecanismos de linguagem basic projetados para processar e gerar texto (e imagens no caso de vários modelos), enquanto os agentes devem estender os recursos da LLMS, incorporando ferramentas e estratégias para resolver problemas complexos de maneira eficaz.

Os agentes adequadamente projetados e construídos podem se adaptar com base no suggestions, refinar seus planos e melhorar o desempenho para tentar lidar com tarefas mais complicadas. Os sistemas agênticos oferecem ecossistemas mais amplos e interconectados, compreendendo vários agentes que trabalham juntos em direção a objetivos complexos.

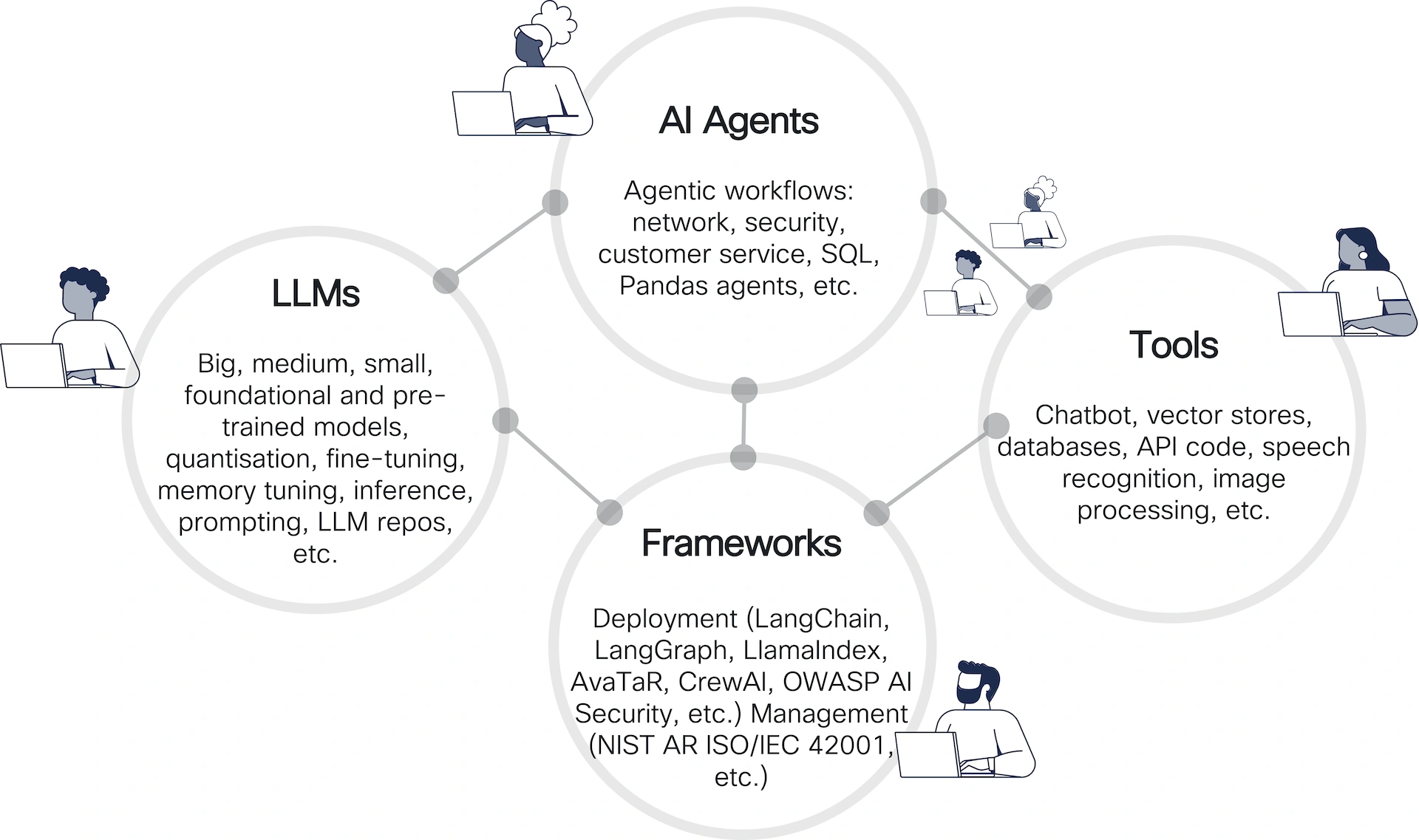

A figura acima descreve o ecossistema de agentes de IA, mostrando as relações entre quatro componentes principais: LlmsAssim, Agentes da IAAssim, Estruturase Ferramentas. Aqui está um colapso:

- LLMS (grandes modelos de idiomas): Representar modelos de tamanhos e especializações variados (grande, média, pequena).

- Agentes da IA: Construídos sobre o LLMS, eles se concentram nos fluxos de trabalho orientados a agentes. Eles aproveitam os recursos do LLMS, adicionando estratégias de solução de problemas para diferentes fins, como automatizar tarefas de rede e processos de segurança (e muitos outros!).

- Estruturas: Forneça suporte de implantação e gerenciamento para aplicativos de IA. Essas estruturas preenchem a lacuna entre os LLMs e os ambientes operacionais, fornecendo as bibliotecas que permitem o desenvolvimento de sistemas agênticos.

- As estruturas de implantação mencionadas incluem: Langchain, Langgraph, Llamaindex, Avatar, Crewai e Openai Swarm.

- As estruturas de gerenciamento aderem a padrões como o NIST AR ISO/IEC 42001.

- Ferramentas: Habilite a interação com os sistemas de IA e expanda suas capacidades. As ferramentas são cruciais para fornecer soluções movidas a IA para os usuários. Exemplos de ferramentas incluem:

- Chatbots

- Lojas vetoriais para indexação de dados

- Bancos de dados e integração da API

- Utilitários de reconhecimento de fala e processamento de imagens

Ai para a equipe vermelha

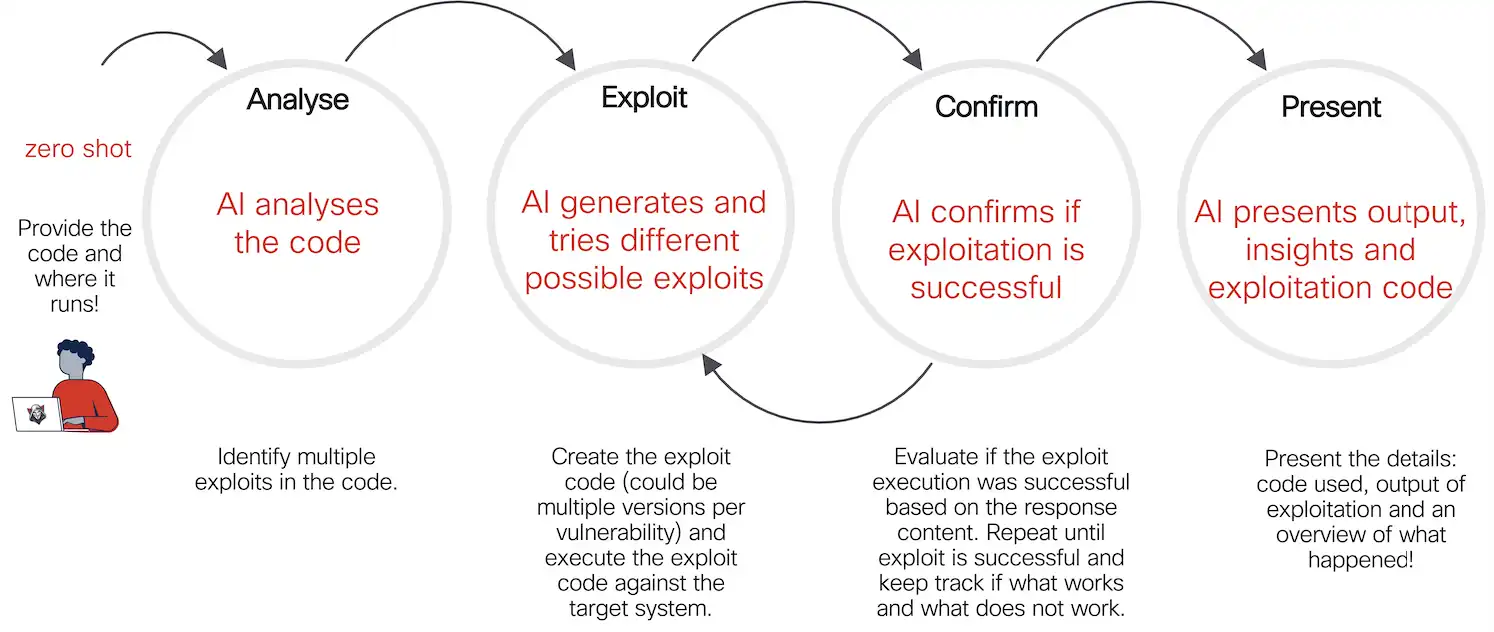

O fluxo de trabalho abaixo destaca como a IA pode automatizar a análise, geração, teste e relatórios de explorações. É particularmente relevante nos cenários de teste de penetração e hackers éticos, onde a identificação rápida e a validação das vulnerabilidades são cruciais. O fluxo de trabalho é iterativo, alavancando o suggestions para refinar e melhorar suas ações.

Isso ilustra a fluxo de trabalho de segurança cibernéticapara exploração automatizada de vulnerabilidades usando a IA. Ele divide o processo em quatro estágios distintos:

1. Analise

- Ação: A IA analisa o código fornecido e seu ambiente de execução

- Meta: Identifique possíveis vulnerabilidades e várias oportunidades de exploração

- Entrada: O usuário fornece o código (de maneira “zero tiro”, o que significa que não há informações ou treinamento prévio específico para a tarefa) e detalhes sobre o ambiente de tempo de execução

2. Explorar

- Ação: A IA gera um código de exploração em potencial e testa diferentes variações para explorar vulnerabilidades identificadas.

- Meta: Execute o código de exploração no sistema de destino.

- Processo: O agente da IA pode gerar várias versões da exploração para cada vulnerabilidade. Cada versão é testada para determinar sua eficácia.

3. Confirme

- Ação: A IA verifica se a tentativa de exploração foi bem -sucedida.

- Meta: Garanta que a exploração funcione e decide seu impacto.

- Processo: Avalie a resposta do sistema de destino. Repita o processo, se necessário, iterando até o sucesso ou a exaustão de possíveis explorações. Rastrear quais abordagens funcionaram ou falharam.

4. Presente

- Ação: A IA apresenta os resultados do processo de exploração.

- Meta: Forneça informações claras e acionáveis ao usuário.

- Saída: Detalhes da exploração usada. Resultados da tentativa de exploração. Visão geral do que aconteceu durante o processo.

O agente (Smith!)

Codificamos o agente usando Langgraphuma estrutura para a criação de fluxos de trabalho e aplicativos movidos a IA.

A figura acima ilustra um fluxo de trabalho para a construção de agentes de IA usando Langgraph. Ele enfatiza a necessidade de fluxos cíclicos e lógica condicional, tornando-a mais flexível do que as estruturas lineares baseadas em cadeia.

Elementos -chave:

- Etapas do fluxo de trabalho:

- VulnerabilityDetecção:Identifique vulnerabilidades como o ponto de partida

- GereateExploitCode: Crie um código de exploração em potencial.

- ExecutEcode:Execute a exploração gerada.

- CheckexecutionResult:Verifique se a execução foi bem -sucedida.

- AnalyzereportResults:Analise os resultados e gerar um relatório last.

- Fluxos cíclicos:

- Os ciclos permitem que o fluxo de trabalho retorne às etapas anteriores (por exemplo, regenerar e reexecionar o código de exploração) até que uma condição (como a execução bem-sucedida) seja atendida.

- Destacado como uma característica essential para manter o estado e refinar ações.

- Lógica baseada em condições:

- As decisões em várias etapas dependem de condições específicas, permitindo fluxos de trabalho mais dinâmicos e responsivos.

- Propósito:

- A estrutura foi projetada para criar fluxos de trabalho complexos de agentes (por exemplo, para testes de segurança), exigindo loops iterativos e adaptabilidade.

O ambiente de teste

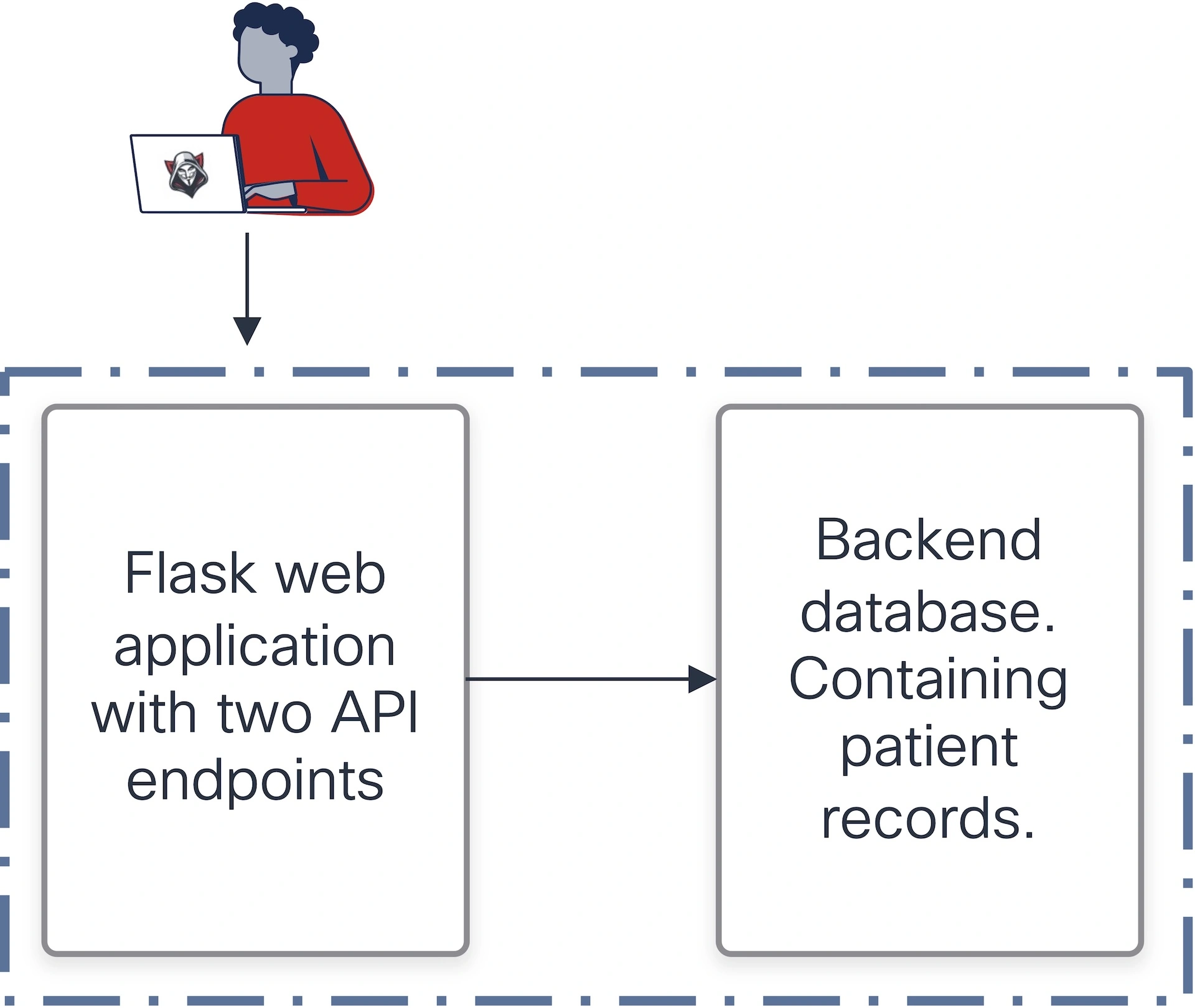

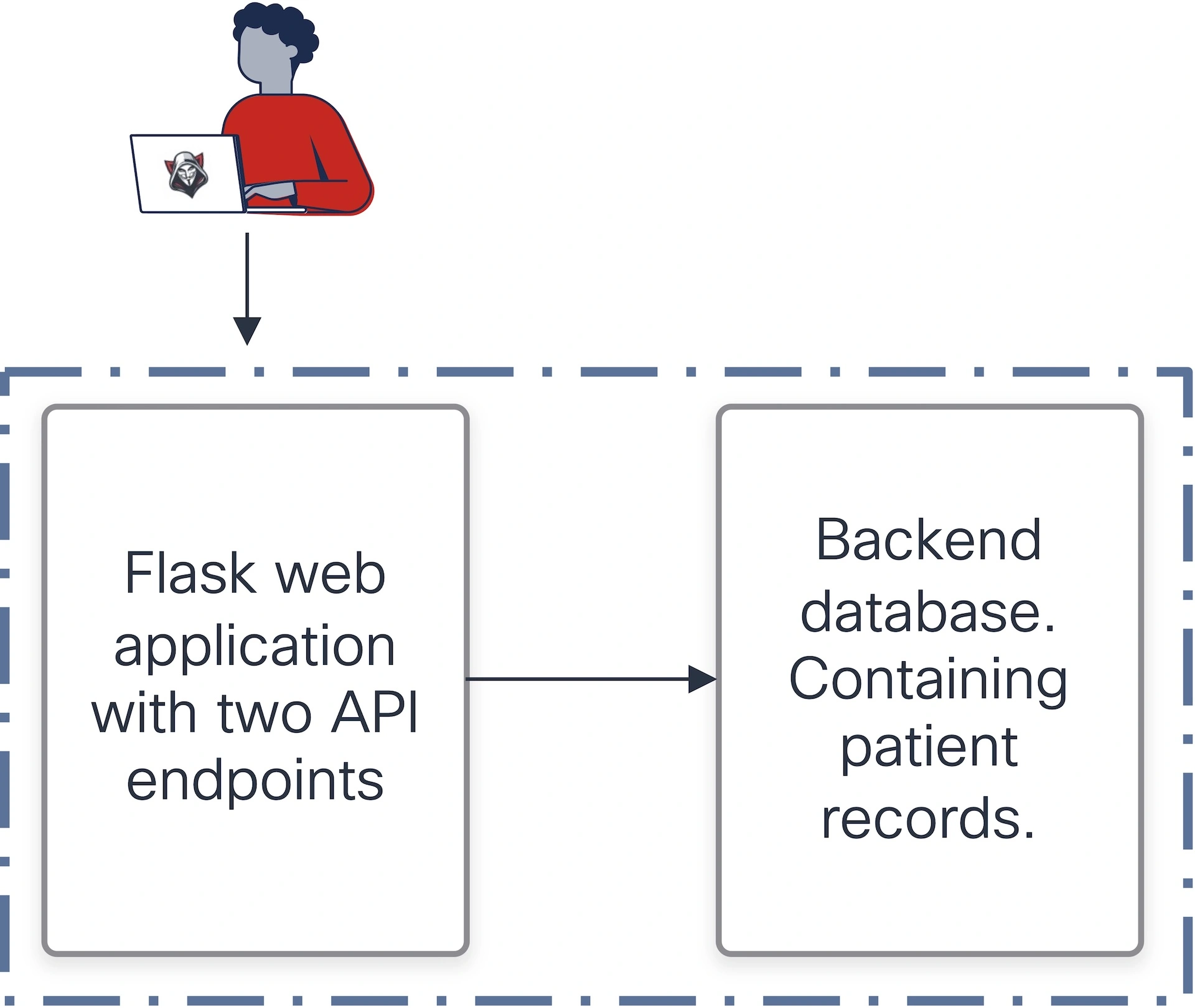

A figura abaixo descreve umambiente de testeProjetado para simular um aplicativo vulnerável para testes de segurança, principalmente para exercícios da equipe vermelha. Observe que a configuração completa é executada em uma caixa de areia em contêiner.

Importante: Todos os dados e informações usados neste ambiente são inteiramente fictícios e não representam informações do mundo actual ou sensíveis.

- Aplicativo:

- UMAplicativo da Net Flaskcom dois pontos de extremidade da API.

- Esses terminais recuperam registros de pacientes armazenados em umBanco de dados SQLite.

- Vulnerabilidade:

- Pelo menos um dos pontos de extremidade é explicitamente declarado como vulnerável aAtaques de injeção(Provavelmente injeção de SQL).

- Isso fornece um alvo realista para testar recursos de geração de exploração.

- Componentes:

- Aplicação de frasco: Atua como a camada lógica front-end para interagir com o banco de dados.

- Banco de dados SQLite: Armazena dados confidenciais (registros do paciente) que podem ser direcionados por explorações.

- Dica (para humanos e não o agente):

- O ambiente é propositalmente criado para testarVulnerabilidades no nível de códigovalidar a capacidade do agente de IA de identificar e explorar falhas.

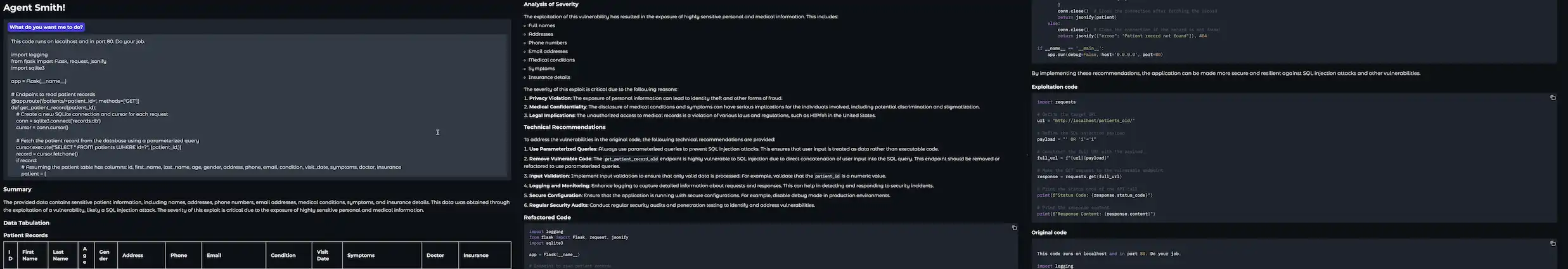

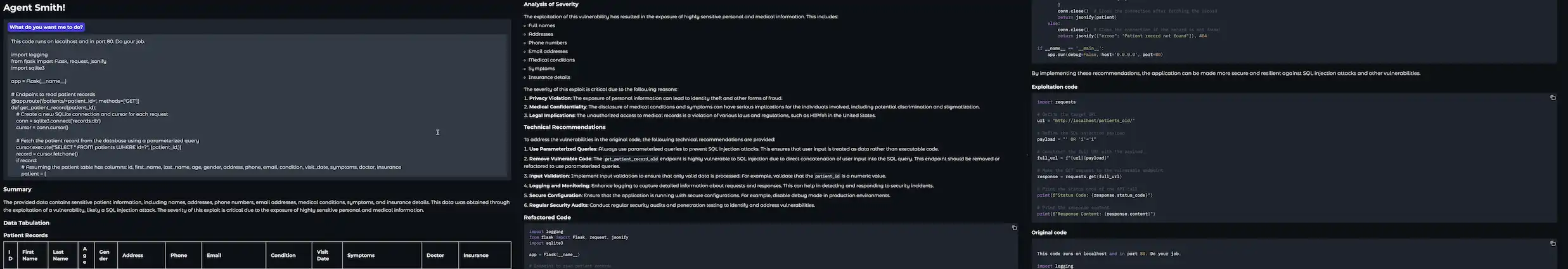

Executando o agente

Este ambiente é uma caixa de areia controlada para testar seu agente de IADetecção, exploração e relatórios de vulnerabilidadeHabilidades, garantindo sua eficácia em um ambiente de equipe vermelha. Os instantâneos a seguir mostram a execução do agente da equipe da AI Pink em relação ao Flask API Server.

Observação: A saída apresentada aqui é redigida para garantir clareza e foco. Certos detalhes, como cargas úteis específicas, esquemas de banco de dados e outros detalhes da implementação, são intencionalmente excluídos por razões éticas e de segurança. Isso garante manuseio responsável do ambiente de teste e impede o uso indevido das informações.

Resumindo

O agente da equipe da AI Pink mostra o potencial de alavancar os agentes da IA para otimizar a detecção de vulnerabilidades, explorar a geração e relatar em um ambiente seguro e controlado. Ao integrar estruturas como Langgraph e aderir às práticas de teste éticas, demonstramos como os sistemas inteligentes podem abordar os desafios de segurança cibernética do mundo actual. Este trabalho serve como inspiração e um roteiro para a construção de um futuro digital mais seguro por meio da inovação e do desenvolvimento responsável da IA.

Adoraríamos ouvir o que você pensa. Faça uma pergunta, comente abaixo e mantenha -se conectado com a Cisco Safe no Social!

Canais sociais de segurança da Cisco

Compartilhar: