Muitas equipes no native de trabalho agora usam o ChatGPT, pois lhes permite concluir os projetos de redação rapidamente, considerar questões complexas e lidar facilmente com tarefas que devem ser repetidas. Agora usamos a IA regularmente para escrever e -mails, fazer anotações e gerar novas idéias.

No entanto, assim como qualquer outra ferramenta forte, nossa abordagem é importante. Se não colocarmos as salvaguardas necessárias, podemos fornecer dados privados, usar IA sem verificar ou usar tecnologias de IA contra políticas ou ética da empresa. Como resultado, toda organização deve garantir que suas equipes estejam usando o ChatGPT com responsabilidade.

Explicaremos neste artigo por que o uso responsável é tão essencial, quais princípios você deve seguir, que programa de treinamento é necessário, como estabelecer diretrizes definidas e os principais recursos para apoiar sua equipe de estagiários no uso de mídias sociais com segurança.

Por que o uso certo do ChatGPT importa?

Saber as limitações do chatgpt é essencial antes de você começar a usá -lo.

Lidar com a questão de proteger muito os dados pessoais. Se você comunicar informações confidenciais no ChatGPT, ele pode acabar deixando a empresa por acidente.

E, finalmente, há alucinação, quando a IA cria informações, acredita ser verdadeira, mas acaba sendo falsa. Apreciar o processo pode levar você a confiar nos dados errados.

Outro problema é o viés. O ChatGPT foi treinado usando muitos dados da Web para que ele possa exibir ou aprimorar quaisquer vieses nas informações. Depois de usar a ferramenta por um tempo, as pessoas podem começar dependendo tanto disso que ignoram o pensamento e o julgamento críticos.

Essas preocupações também envolvem questões de regulamentos e ética. Erros relativos à sua privacidade, co-falante ou requisitos on-line relacionados podem ter questões legais e de imagem pública para a empresa.

Se a IA for usada de forma irresponsável, pode quebrar a confiança, resultar em questões gerais e convidar erros caros. Portanto, devemos garantir que as equipes sejam informadas e guiadas sobre como usar o ChatGPT com segurança e adequação.

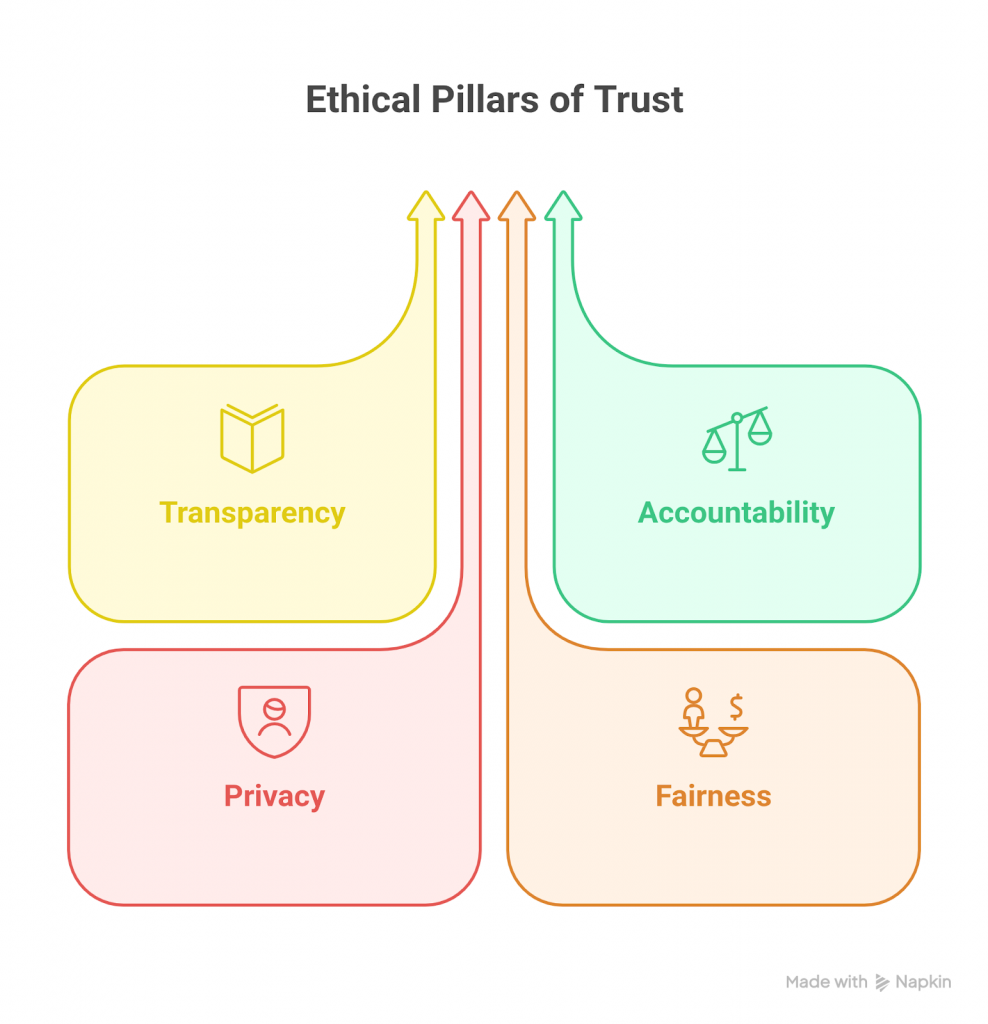

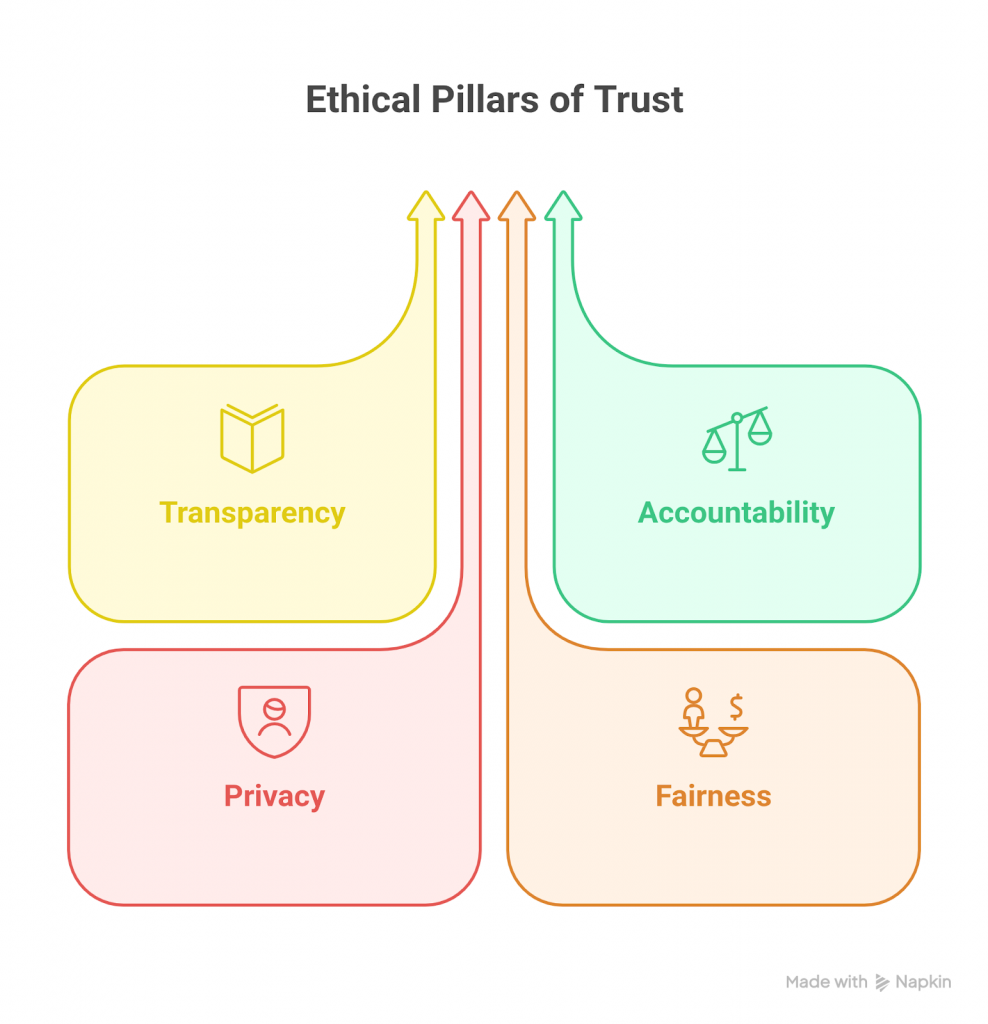

Princípios -chave do uso de IA responsável

Usar o chatgpt significa ser responsável e atento às suas habilidades. Começa com algumas idéias principais.

Primeiro é transparência. Se você estiver usando a IA para ajudar a criar conteúdo, seja um e mail do cliente, um relatório ou até mesmo mensagens internas, é essencial ser franco sobre isso. As pessoas merecem saber quando estão interagindo com algo gerado ou assistido por uma máquina.

Então vem responsabilidade. O ChatGPT pode ser útil, mas não deve substituir o julgamento humano. Qualquer coisa que a ferramenta produz deve ser revisada, verificada e, finalmente, aprovada por alguém que entenda o contexto e as consequências do conteúdo.

Privacidade e segurança de dados também são não negociáveis. As equipes devem evitar colocar informações confidenciais em instruções, como dados do cliente, planos internos ou arquivos confidenciais. Mesmo que pareça inofensivo, uma vez que esses dados saem, você nem sempre pode controlar para onde vai.

Finalmente, mantenha justiça e preconceito em mente. Às vezes, o modelo pode refletir vieses ocultos dos dados em que foi treinado. Isso significa ser atencioso sobre tom, linguagem e suposições, e estar disposto a recuar ou retrabalhar os resultados quando algo não parece certo.

Esses princípios estabelecem a base para uso seguro, respeitoso e inovador.

Treinando essenciais para as equipes

Compreendendo a ferramenta

Antes de usar o ChatGPT, as pessoas devem conhecer seus pontos fortes e fracos. O ChatGPT pode escrever textos, reduzir documentos, produzir idéias e apoiar o processo de pensamento.

No entanto, não tem o mesmo entendimento que as pessoas, e às vezes pode estar errado. Não consegue entender o que está acontecendo agora e nem sempre sabe que cometeu um erro.

A prática deve se concentrar no ponto em que o ChatGPT é uma ferramenta para escrever, não uma fonte de respostas ou alguém que possa tomar decisões cruciais. O julgamento humano deve ser usado além das máquinas, em vez de substituí -lo.

Ao ajudar as equipes a entender o que o ChatGPT pode e não pode fazer, é útil oferecer aprendizado estruturado. Por exemploesse Curso grátis no chatgpt for Enterprise Communication Oferece aos profissionais uma base clara sobre o uso da ferramenta de maneira eficaz nos cenários diários do native de trabalho.

Promover o pensamento crítico

Devemos lembrar de não aceitar os resultados fornecidos pela IA simplesmente. Fazer uma declaração ousada não garante que seja verdade. Solicite as equipes a demorarem o tempo e a ler as instruções.

O conteúdo faz sentido? Os fatos estão corretos? O tom é apropriado? A verificação é importante, especialmente ao usar o conteúdo gerado pela IA nas comunicações dos clientes, materiais públicos ou qualquer coisa que carregue riscos.

Trate as respostas do ChatGPT como rascunhos ou pontos de partida, não respostas finais. As equipes devem se sentir confortáveis desafiando os resultados, editando -os ou jogando -os se não atingirem a marca.

Práticas de entrada seguras

A boa saída começa com entrada segura. As equipes nunca devem entrar em informações privadas, pessoais ou confidenciais no ChatGPT. Isso inclui nomes de clientes, dados dos funcionários, detalhes financeiros, senhas ou documentos internos.

Uma boa regra prática: se você não a enviar para alguém fora da organização, não coloque -o no chatgpt. Use dados gerais ou anonimizados ao experimentar ou solicitar.

Também é inteligente lembrar às equipes que, embora o ChatGPT possa simular a conversa humana, ainda é uma máquina e não deve ser tratada como um espaço de trabalho seguro e privado.

Use diretrizes de casos

Limites claros ajudam bastante a construir confiança. As equipes devem saber o que chatgpt pode ser usado para e onde está a linha. Os casos de uso aprovados incluem escrever contornos, elaborar e-mails básicos ou resumir informações não sensíveis.

Os usos proibidos podem incluir a geração de aconselhamento jurídico, a substituição de comunicações regulamentadas ou o manuseio de dados confidenciais do cliente. É possível que uma lista básica de bons e maus hábitos possa garantir que todos entendam como usar a ferramenta com segurança.

Certifique -se de que as diretrizes sejam disponibilizadas para todos os funcionários e que você as atualize sempre que as necessidades da sua empresa mudam.

Desenvolvimento de diretrizes e políticas internas

As organizações precisam de mais do que boas intenções de usar o ChatGPT com responsabilidade em escala. Eles precisam de diretrizes claras e práticas que todos possam seguir.

- Comece desenvolvendo regras contextuais que refletem seu setor, sensibilidade de dados e fluxos de trabalho internos.

Por exemplo, uma equipe de advertising pode usar o ChatGPT para elaborar postagens de weblog, enquanto uma equipe jurídica deve evitar usá -lo para o idioma do contrato. As regras devem corresponder aos riscos e realidades de cada departamento.

- A consistência é basic. Sem ele, as equipes podem desenvolver suas próprias práticas informais- algumas outras, outras não.

Um conjunto compartilhado de expectativas ajuda a manter todos na mesma página e reduz o risco de uso indevido. Isso pode incluir ferramentas aprovadas por nomeação, definição de casos de uso aceitáveis e sinalizando cenários de alto risco.

- Também ajuda a criar simples e repetível modelos e exemplos. Mostre aos funcionários como é um immediate seguro. O esboço quando o conteúdo precisa ser revisado por um gerente ou pela equipe de conformidade.

Por exemplo: “Use a IA para brainstorming, mas toda a cópia voltada para o cliente deve ser revisada antes da publicação”.

- Quando as políticas são claras e fáceis de aplicar, é mais provável que sejam seguidas. Esses corrimãos internos transformam o uso responsável da IA de um conceito em uma prática consistente e diária.

Para aqueles que moldam políticas de uso interno de IA ou estruturas de treinamento, o aprendizado mais profundo ajuda. Programas como o Programa de Aprendizado AI e Machine Ofereça informações essenciais sobre como essas ferramentas funcionam, ajudando os líderes a definir padrões realistas e seguros para uso.

Aprendizagem e melhoria contínuas

A tecnologia não fica parada, nem a abordagem da sua equipe deve usar ferramentas como o ChatGPT. À medida que os novos recursos são lançados ou as necessidades da empresa mudam, é essencial continuar aprendendo e ajustando.

As oportunidades regulares de aprendizado ajudam os funcionários a acompanhar o ritmo das mudanças de IA e a melhorar suas habilidades. Cursos como Chatgpt for Working Professionals são ótimos para isso-eles são projetados para se encaixar em horários movimentados, oferecendo aplicativos práticos e práticos.

Abra espaço para check-ins regulares. Pergunte às equipes o que está funcionando, onde estão tendo problemas e o que poderia ser melhorado. Esses insights podem ajudá-lo a ajustar o treinamento, atualizar diretrizes ou capturar pontos cegos mais cedo.

Ocasionalmente, verifica como a ferramenta é usada, nada pesado, também pode ajudar a superfície de problemas antes que eles se tornem problemas reais.

Igualmente valioso é incentivar as equipes a trocar dicas para o uso do bate -papo GPT. Um simples tópico de folga ou almoço e aprendizado pode percorrer um longo caminho. Quando as pessoas compartilham como estão usando bem o ChatGPT, outras se beneficiam e a qualidade geral do trabalho melhora.

Não se trata de dominar a ferramenta uma vez e esquecê -la. Trata -se de manter a conversa aberta, permanecer curiosa e ajudar todos a melhorar com o tempo.

Dar às equipes as ferramentas certas facilitam o uso responsável.

- Comece com Módulos de treinamento Essa caminhada por fazenda e não, emparelhada com documentação interna ou wikis fácil de ler para referência rápida.

Se sua organização usar ferramentas de monitoramento, elas podem ajudar a rastrear padrões de uso e sinalizar riscos potenciais.

- Openai e outros provedores também oferecem modelos de política, diretrizes imediatas e recursos de segurança Isso pode ser adaptado para atender às suas necessidades.

Level equipes desses materiais como parte do integração ou treinamento common. Quando o suporte é fácil de acessar, as pessoas têm muito mais probabilidade de usar a ferramenta com atenção e dentro de limites seguros.

Para apoiar o aprendizado, considere apontar as equipes para cursos bem projetados ou opções internas de upskilling. Programas como o Curso AI generativo pode aprofundar o entendimento, especialmente para papéis que estão moldando políticas internas ou fluxos de trabalho em torno da IA.

Para quem procura acesso flexível e contínuo a upskilling profissional, lançamos recentemente Academia Professionalum plano de assinatura que desbloqueia todos os nossos cursos premium por apenas ₹ 799/mês.

Com isso, os alunos não precisam mais comprar cursos individuais, tornando mais fácil e acessível para as equipes criarem continuamente suas capacidades de IA e permanecerem atualizadas com as últimas práticas de uso responsáveis

Conclusão

O ChatGPT e as ferramentas semelhantes estão se tornando parte do equipment de ferramentas do cotidiano no trabalho. Mas, como qualquer ferramenta, como ela é usada faz toda a diferença. Com um pouco de estrutura e treinamento claro, as equipes podem usá -lo bem sem arriscar dados, reputação ou confiança confidenciais.

Os líderes têm um papel importante em fazer isso acontecer. Investir em treinamento e definir algumas diretrizes simples e simples ajuda a todos permanecer na mesma página.

Se você ainda não o fez, agora é um ótimo momento para revisar ou criar políticas internas. Alguns passos pensativos hoje podem economizar muitos problemas no caminho.