O processamento de imagens ressurgiu com lançamentos como Nano Banana e Qwen Picture, ampliando os limites do que period possível anteriormente. Não estamos mais presos a dedos extras ou textos quebrados. Esses modelos podem produzir imagens e ilustrações realistas que imitam o trabalho de um designer. O último lançamento do Meta, SAM3D, está aqui para dar sua própria contribuição a este ecossistema. Com uma abordagem engenhosa à modelagem de objetos e corpos 3D, está aqui para se apresentar como uma adição bem-vinda ao arsenal de qualquer designer.

Este artigo detalhará o que é SAM3D, como você pode acessá-lo e uma prática para avaliar suas capacidades.

O que é SAM3D?

SAM3D ou Phase Something Mannequin 3D é um sistema de última geração para segmentação espacial em cenas totalmente 3D. Ele funciona em nuvens de pontos, mapas de profundidade e volumes reconstruídos e recebe texto ou prompts em vez de rótulos de classe fixos. Trata-se de detecção e extração de objetos que opera diretamente no espaço tridimensional com compreensão orientada por IA. Embora os modelos 3D existentes possam segmentar courses amplas como Humano ou Cadeira, o SAM3D pode isolar conceitos muito mais específicos, como a luminária alta ao lado do sofá.

O SAM3D supera esses limites usando segmentação de conceito agilizável no espaço 3D. Ele pode localizar e extrair qualquer objeto descrito dentro de uma cena digitalizada, seja com uma frase curta, um ponto ou uma forma de referência, sem depender de uma lista definida de categorias.

Como acessar o SAM3?

Aqui estão algumas maneiras pelas quais você pode obter acesso ao modelo SAM3:

- Playground/demonstração baseado na Net: Existe uma interface net “Segmentar qualquer coisa Playground”, onde você pode fazer add de uma imagem ou vídeo, fornecer um immediate de texto (ou exemplar) e experimentar a funcionalidade de segmentação e rastreamento do SAM 3D.

- Pesos do modelo + código no GitHub: O repositório oficial da Meta Analysis (pesquisa no Fb / sam-3d-body) inclui código para inferência e ajuste fino, além de hyperlinks para baixar pontos de verificação do modelo treinado.

- Abraçando o hub do modelo Face: O modelo está disponível no Hugging Face (abraço/SAM3D) com descrição, como carregar o modelo, exemplo de uso para imagens/vídeos.

Você pode encontrar outras formas de acessar o modelo na página oficial de lançamento do SAM3D.

Implementação Prática do SAM3

Vamos sujar as mãos. Para ver o desempenho do SAM3D, eu o testaria nas duas tarefas:

- Crie cenas 3D

- Crie corpos 3D

A imagem usada para demonstração são os exemplos de imagens oferecidos pela Meta em seu playground.

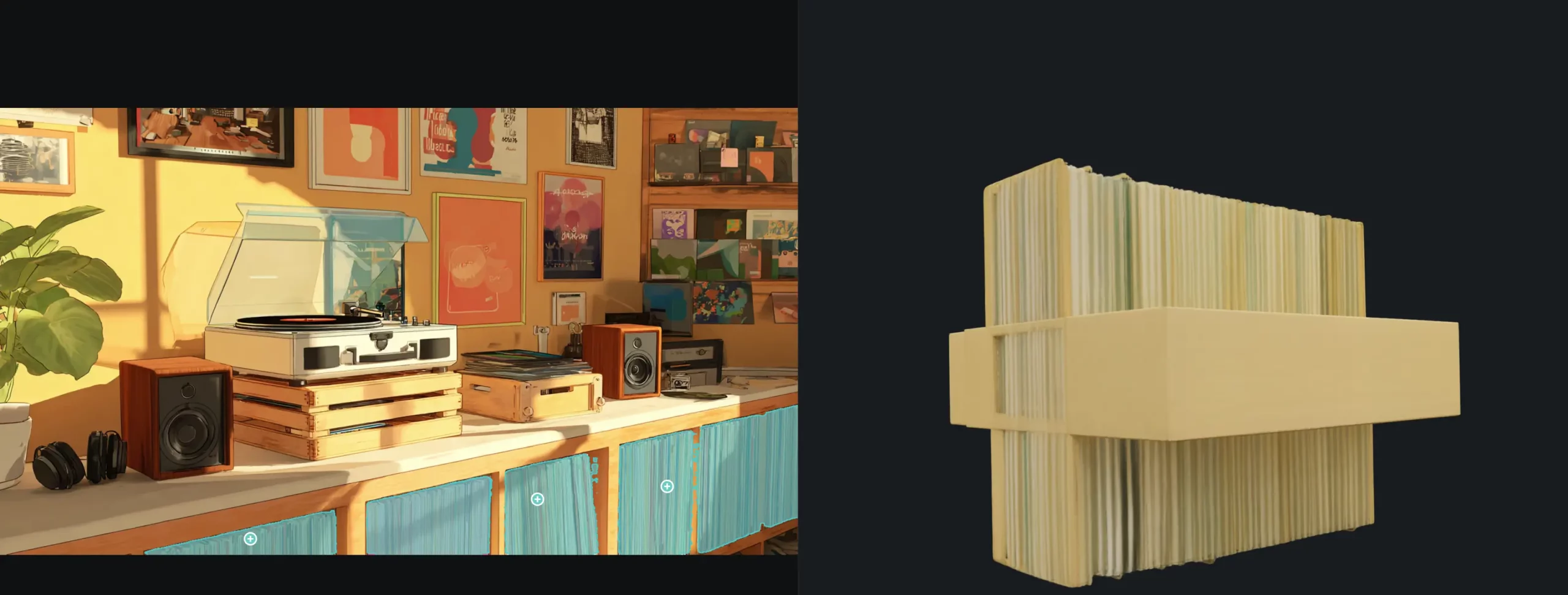

Crie cenas 3D

Esta ferramenta permite a modelagem 3D de objetos a partir de uma imagem. Basta clicar em um objeto e um contorno será criado em torno dele, que você poderá refinar ainda mais. Para este teste usaríamos a seguinte imagem:

Resposta:

Recebi a seguinte resposta após selecionar a máquina de café:

O modelo foi reconhecido como uma máquina de café e foi capaz de modelá-la de forma semelhante a uma. Se você olhar atentamente a visualização, havia partes do café que nem estavam presentes na imagem, mas o modelo fez isso sozinho, baseado no entendimento de uma máquina de café.

Crie corpos 3D

Para reconhecimento corporal 3D, eu testaria quão bem o modelo mapeia um ser humano em uma determinada imagem. Para demonstração, eu usaria a seguinte imagem:

Resposta:

Ele identificou corretamente a única pessoa no clipe e criou um modelo 3D interativo de seu corpo. Ficava próximo ao formato do corpo, o que period desejável. Para imagens que não consistem em vários assuntos e são de alta qualidade, esta ferramenta seria útil.

Veredicto

O modelo faz o seu trabalho. Mas não posso deixar de me sentir restrito ao usá-lo, especialmente em comparação com SAM3 que é muito mais personalizável. Além disso, a modelagem 3D não é perfeita, especialmente no caso de detecção de objetos.

Aqui estão alguns dos problemas gritantes que percebi usando a ferramenta:

- Limitado a imagens simples: O modelo corporal 3D teve um bom desempenho quando usei as imagens de amostra fornecidas pelo Meta como entrada. Mas tive dificuldades e tive um desempenho ruim quando forneci imagens que não eram de alta qualidade e adaptadas à ferramenta:

- Sem seleção guide: A ferramenta corporal 3D reconhece os próprios corpos humanos e não permite qualquer demarcação. Isso dificulta o uso da ferramenta quando o contorno do corpo não está correto ou não está do nosso agrado.

- Falhas e tempos limite: Quando a imagem de entrada é complicada e contém mais de um assunto (como no primeiro ponto), o modelo leva muito tempo não só para identificar os corpos, mas também muitos recursos de {hardware}. A tal ponto que às vezes a página travava por falta de recursos.

Conclusão

O SAM3D eleva o nível de trabalho com cenas 3D, tornando a segmentação espacial avançada muito mais fácil de usar. O que ele traz para nuvens de pontos e volumes é um grande avanço, enquanto sua capacidade de segmentar em múltiplas visualizações abre novas possibilidades. SAM3D emparelhado com SAM3 transforma a dupla em uma escolha forte para quem deseja compreensão de cena com tecnologia de IA em 2D e 3D. O modelo ainda está em evolução e as suas capacidades continuarão a expandir-se à medida que a investigação amadurece.

Perguntas frequentes

A. Ele segmenta objetos em 3D completo usando texto ou dicas de immediate em vez de rótulos de classe fixos.

R. Sim. Ele pode extrair conceitos detalhados, como uma única lâmpada ou um merchandise específico com base em instruções.

A. Por meio do playground da net, do código e dos pesos do GitHub ou do hub do modelo Hugging Face.

Faça login para continuar lendo e desfrutar de conteúdo com curadoria de especialistas.