Os modelos OpenAI evoluíram drasticamente nos últimos anos. A jornada começou com o GPT-3.5 e agora alcançou o GPT-5.1 e os modelos de raciocínio da série O mais recentes. Embora o ChatGPT use GPT-5.1 como modelo principal, a API oferece acesso a muito mais opções projetadas para diferentes tipos de tarefas. Alguns modelos são otimizados para velocidade e custo, outros são construídos para raciocínio profundo e alguns são especializados em imagens ou áudio.

Neste artigo, apresentarei todos os principais modelos disponíveis por meio da API. Você aprenderá para que cada modelo é mais adequado, para que tipo de projeto ele se adapta e como trabalhar com ele usando exemplos de código simples. O objetivo é fornecer uma compreensão clara de quando escolher um modelo específico e como usá-lo de forma eficaz em uma aplicação actual.

GPT-3.5 Turbo: as bases da IA moderna

O Turbo GPT-3.5 iniciou a revolução da IA generativa. O Bate-papoGPT também pode alimentar o authentic e também é uma solução estável, barata e de baixo custo para tarefas simples. O modelo se resume a obedecer às instruções e conduzir uma conversa. Tem a capacidade de responder a perguntas, resumir textos e escrever códigos simples. Os modelos mais recentes são mais inteligentes, mas o GPT-3.5 Turbo ainda pode ser aplicado a tarefas de alto quantity onde o custo é a principal consideração.

Principais recursos:

- Velocidade e custo: É muito rápido e muito barato.

- Ação após instrução: também é um sucessor confiável de prompts simples.

- Contexto: Justifica a janela do token 4K (aproximadamente 3.000 palavras).

Exemplo prático:

A seguir está um breve Pitão script para usar GPT-3.5 Turbo para resumo de texto.

import openai

from google.colab import userdata

# Set your API key

shopper = openai.OpenAI(api_key=userdata.get('OPENAI_KEY'))

messages = (

{"position": "system", "content material": "You're a useful summarization assistant."},

{"position": "consumer", "content material": "Summarize this: OpenAI modified the tech world with GPT-3.5 in 2022."}

)

response = shopper.chat.completions.create(

mannequin="gpt-3.5-turbo",

messages=messages

)

print(response.decisions(0).message.content material)Saída:

Família GPT-4: Potências Multimodais

O GPT-4 família foi um enorme avanço. Essas séries são GPT-4, GPT-4 Turbo e o muito eficiente GPT-4o. Esses modelos são multimodais, ou seja, são capazes de compreender tanto texto quanto imagens. Sua principal força reside no pensamento complicado, na pesquisa jurídica e na redação criativa e sutil.

Recursos do GPT-4o:

- Entrada multimodal: Ele lida com textos e imagens ao mesmo tempo.

- Velocidade: GPT-4o (o é Omni) é duas vezes mais rápido que GPT-4.

- Preço: É muito mais barato que o modelo GPT-4 tradicional.

Um estudo da openAI revelou que o GPT-4 alcançou um teste de barra simulado entre os 10% melhores indivíduos que fizeram o teste. Esta é uma indicação de sua capacidade de lidar com lógica sofisticada.

Exemplo prático (lógica complexa):

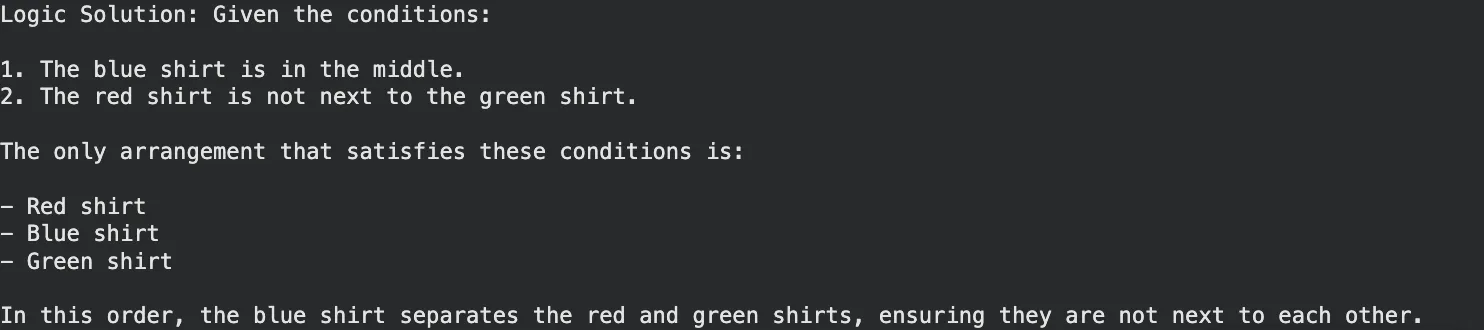

O GPT-4o tem a capacidade de resolver um quebra-cabeça lógico que envolve raciocínio.

messages = (

{"position": "consumer", "content material": "I've 3 shirts. One is pink, one blue, one inexperienced. "

"The pink will not be subsequent to the inexperienced. The blue is within the center. "

"What's the order?"}

)

response = shopper.chat.completions.create(

mannequin="gpt-4o",

messages=messages

)

print("Logic Answer:", response.decisions(0).message.content material)Saída:

A série o: modelos que pensam antes de falar

No closing de 2024 e início de 2025, a OpenAI anunciou a série o (o1, o1-mini e o3-mini). Estes são “modelos de raciocínio”. Eles não respondem imediatamente, mas levam tempo para pensar e elaborar uma estratégia diferente dos modelos normais de GPT. Isso os torna superiores em matemática, ciências e codificação difícil.

Destaques o1 e o3-mini:

- Cadeia de Pensamento: Este modelo verifica seus passos internamente minimizando erros.

- Capacidade de codificação: o3-mini foi projetado para ser rápido e preciso em códigos.

- Eficiência: o3-mini é um modelo altamente inteligente a um preço mais barato comparado ao modelo o1 completo.

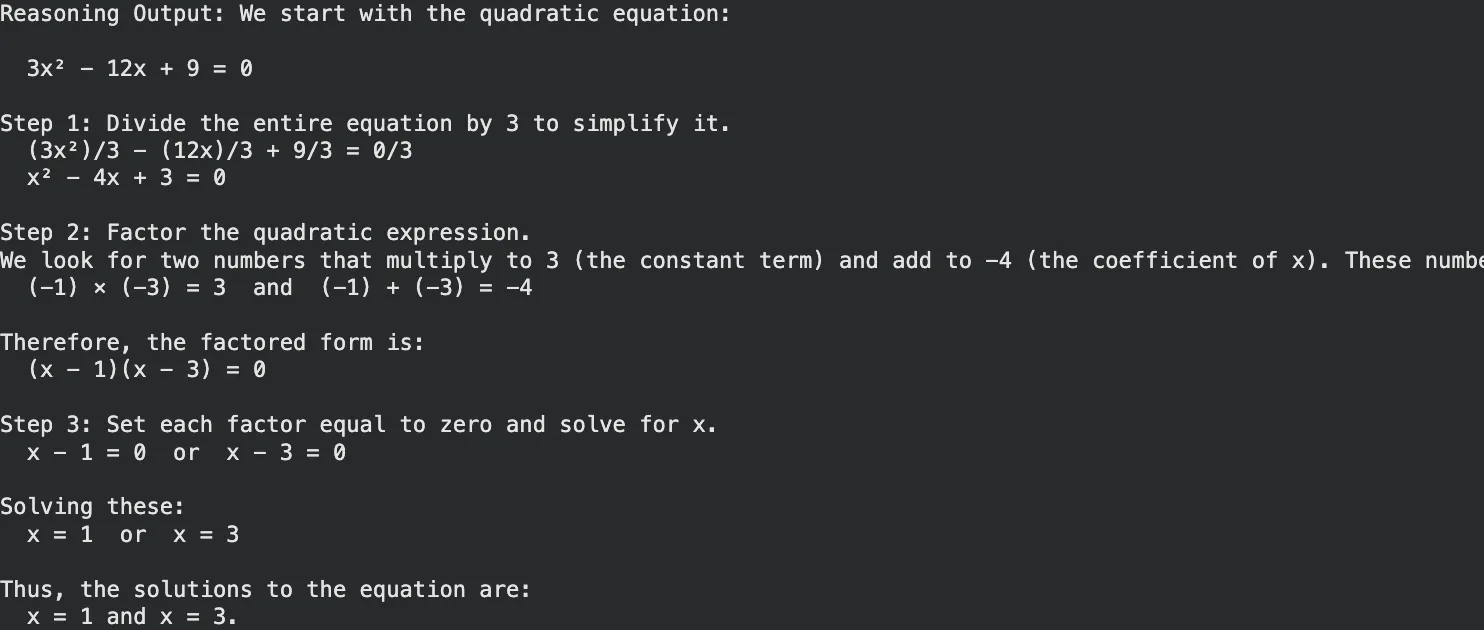

Exemplo prático (raciocínio matemático):

Use o3-mini para um problema matemático onde a verificação passo a passo é essential.

# Utilizing the o3-mini reasoning mannequin

response = shopper.chat.completions.create(

mannequin="o3-mini",

messages=({"position": "consumer", "content material": "Resolve for x: 3x^2 - 12x + 9 = 0. Clarify steps."})

)

print("Reasoning Output:", response.decisions(0).message.content material)Saída:

GPT-5 e GPT-5.1: a próxima geração

Ambos GPT-5 e sua versão otimizada GPT-5.1lançado em meados de 2025, combinou ritmo e lógica. O GPT-5 fornece pensamento integrado, no qual o próprio modelo determina quando pensar e quando responder em um curto espaço de tempo. A versão, GPT-5.1, foi refinada para ter controles empresariais superiores e menos alucinações.

O que os diferencia:

- Pensamento Adaptativo: Ele transforma consultas simples em rotas simples e raciocínio simples em rotas de raciocínio difíceis.

- Grau Empresarial: GPT-5.1 tem a opção de pesquisa profunda com recursos Professional.

- A imagem GPT 1: Este é um menu embutido que substitui DALL-E 3 para fornecer uma criação suave de imagens no bate-papo.

Exemplo prático (estratégia de negócios):

GPT-5.1 é muito bom na estratégia de nível superior que envolve conhecimento geral e pensamento estruturado.

# Instance utilizing GPT-5.1 for strategic planning

response = shopper.chat.completions.create(

mannequin="gpt-5.1",

messages=({"position": "consumer", "content material": "Draft a go-to-market technique for a brand new AI espresso machine."})

)

print("Technique Draft:", response.decisions(0).message.content material)Saída:

Imagem DALL-E 3 e GPT: Criatividade Visible

No caso de dados visuais, OpenAI fornece DALL-E 3 e os modelos mais recentes de imagens GPT. Esses aplicativos transformarão instruções textuais em belas imagens detalhadas. Trabalhar com o DALL-E 3 permitirá desenhar imagens, logotipos e esquemas apenas descrevendo-os.

Leia mais: Geração de imagem usando API de imagem GPT

Principais capacidades:

- Ação Imediata: Observa rigorosamente instruções elaboradas.

- Integração: Está integrado ao ChatGPT e à API.

Exemplo prático (geração de imagem):

Este script gera um URL de imagem com base no seu immediate de texto.

image_response = shopper.pictures.generate(

mannequin="dall-e-3",

immediate="A futuristic metropolis with flying vehicles in a cyberpunk fashion",

n=1,

measurement="1024x1024"

)

print("Picture URL:", image_response.information(0).url)Saída:

Sussurro: domínio da fala para texto

Whisper O sistema de reconhecimento de fala é o que há de mais moderno fornecido pela OpenAI. Ele tem a capacidade de transcrever áudio de dezenas de idiomas para o inglês. É resistente a ruídos de fundo e acentos. O seguinte trecho do tutorial da API Whisper é uma indicação de como é simples de usar.

Exemplo prático (transcrição):

Certifique-se de estar em um diretório com um arquivo de áudio (denominado Speech.mp3).

audio_file = open("speech.mp3", "rb")

transcript = shopper.audio.transcriptions.create(

mannequin="whisper-1",

file=audio_file

)

print("Transcription:", transcript.textual content)Saída:

Incorporações e moderação: as ferramentas utilitárias

OpenAI possui modelos de utilidade que são essenciais para os desenvolvedores.

- Incorporações (incorporação de texto-3-pequeno/grande): Eles são usados para codificar texto como números (vetores). Isso permite que você crie mecanismos de pesquisa que podem decifrar o significado em vez de palavras-chave.

- Moderação: Esta é uma API gratuita que verifica o conteúdo de texto de discurso de ódio, violência ou automutilação para garantir que os aplicativos sejam seguros.

Exemplo prático (pesquisa semântica):

Isso descobre o fato de que existe uma semelhança entre uma consulta e um produto.

# Get embeddings

resp = shopper.embeddings.create(

enter=("smartphone", "banana"),

mannequin="text-embedding-3-small"

)

# In an actual app, you evaluate these vectors to seek out the most effective match

print("Vector created with dimension:", len(resp.information(0).embedding))Saída:

Ajuste fino: personalizando sua IA

O ajuste fino permite o treinamento de um modelo usando seus próprios dados. GPT-4o-mini ou GPT-3.5 podem ser refinados para escolher um tom, formato ou jargão específico da indústria. Isto é poderoso no caso de aplicações empresariais, que não exigem mais do que uma resposta geral.

Como funciona:

- Put together um arquivo JSON com exemplos de treinamento.

- Carregue o arquivo para OpenAI.

- Comece um trabalho de ajuste fino.

- Use seu novo ID de modelo personalizado na API.

Conclusão

O cenário do modelo OpenAI oferece uma ferramenta para quase todas as tarefas digitais. Da velocidade do GPT-3.5 Turbo ao poder de raciocínio do o3-mini e GPT-5.1, os desenvolvedores têm vastas opções. Você pode criar aplicativos de voz com o Whisper, criar ativos visuais com o DALL-E 3 ou analisar dados com os modelos de raciocínio mais recentes.

As barreiras à entrada permanecem baixas. Você simplesmente precisa de uma chave de API e de um conceito. Incentivamos você a testar os scripts fornecidos neste guia. Experimente os diferentes modelos para compreender seus pontos fortes. Encontre o equilíbrio certo entre custo, velocidade e inteligência para suas necessidades específicas. A tecnologia existe para potencializar sua próxima aplicação. Agora cabe a você aplicá-lo.

Perguntas frequentes

R. GPT-4o é um modelo multimodal de uso geral, ideally suited para a maioria das tarefas. o3-mini é um modelo de raciocínio otimizado para problemas complexos de matemática, ciências e codificação.

R. Não, o DALL-E 3 é um modelo pago com preço por imagem gerada. Os custos variam de acordo com as configurações de resolução e qualidade.

R. Sim, o modelo Whisper é de código aberto. Você pode executá-lo em seu próprio {hardware} sem pagar taxas de API, desde que tenha uma GPU.

R. O GPT-5.1 oferece suporte a uma enorme janela de contexto (geralmente 128 mil tokens ou mais), permitindo processar livros inteiros ou longas bases de código de uma só vez.

R. Esses modelos estão disponíveis para desenvolvedores por meio da API OpenAI e para usuários por meio de assinaturas ChatGPT Plus, Group ou Enterprise.

Faça login para continuar lendo e desfrutar de conteúdo com curadoria de especialistas.