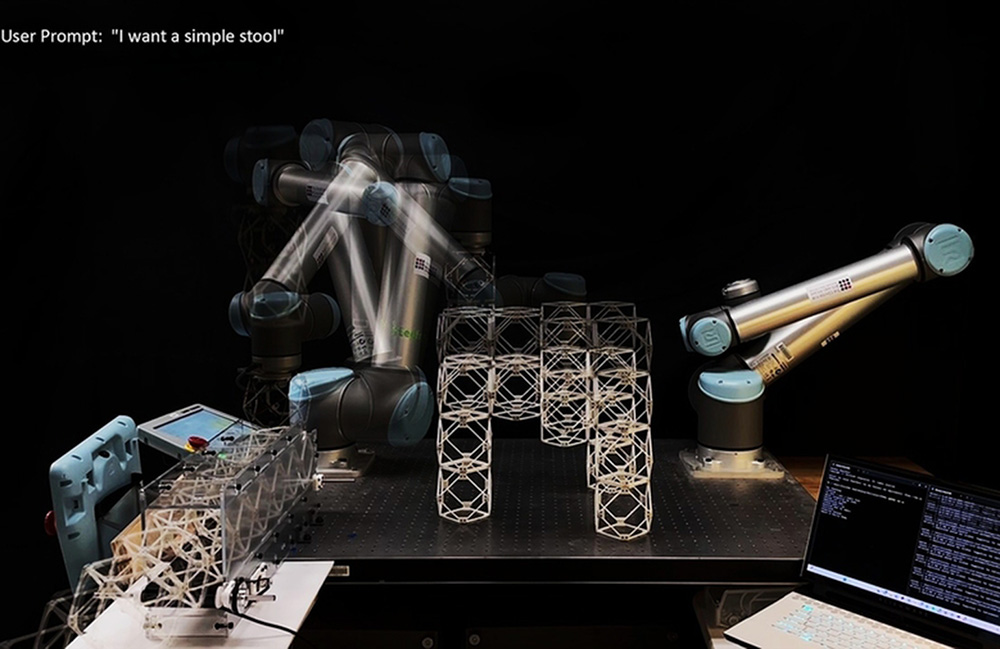

Um braço robótico constrói um banquinho em forma de treliça depois de ouvir a mensagem “Quero um banquinho simples”, traduzindo a fala em montagem em tempo actual. | Fonte: Alexander Kyaw, MIT

Pesquisadores do Instituto de Tecnologia de Massachusetts anunciaram esta semana que desenvolveram um sistema de “fala para realidade”. Esse fluxo de trabalho orientado por IA permite que a equipe do MIT forneça informações para um braço robótico e “fale com que os objetos existam”, criando coisas como móveis em apenas cinco minutos.

O sistema usa um braço robótico montado em uma mesa que pode compreender a entrada falada de um ser humano. Por exemplo, uma pessoa poderia dizer ao robô: “Quero um banco simples”, e o robô então construiria o banco a partir dos componentes modulares.

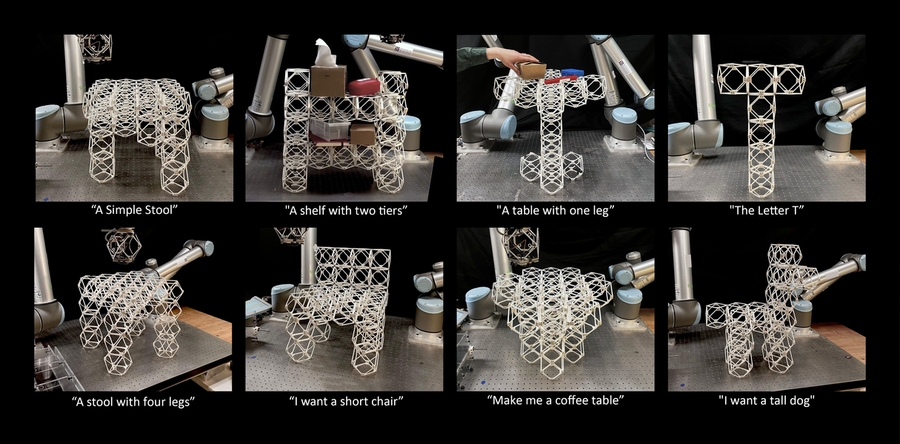

Até agora, o universidade pesquisadores usaram o sistema de fala para realidade para criar bancos, prateleiras, cadeiras, uma pequena mesa e até itens decorativos, como uma estátua de cachorro.

Projeto do MIT se concentra em bits e átomos

“Estamos conectando processamento de linguagem pure, geração 3D IAe montagem robótica”, explicou Alexander Htet Kyaw, estudante de pós-graduação do MIT e Morningside Academy for Design (LOUCO) amigo. “Essas são áreas de pesquisa que avançam rapidamente e que não foram reunidas antes de uma forma que você possa realmente criar objetos físicos apenas a partir de um simples comando de fala.”

A ideia começou quando Kyaw, um estudante de pós-graduação nos departamentos de Arquitetura e Engenharia Elétrica e Ciência da Computação, fez o curso do Prof. Neil Gershenfeld, “Como fazer quase qualquer coisa”.

Nessa aula, ele construiu o sistema de fala para realidade. Após a aula, Kyaw continuou trabalhando no projeto no MIT Heart for Bits and Atoms (CBA), dirigido por Gershenfeld. Colaborou com os alunos de pós-graduação Se Hwan Jeon do Departamento de Engenharia Mecânica e Miana Smith do CBA.

Como funciona o sistema?

O sistema de fala para realidade começa com o reconhecimento de fala que processa a solicitação do usuário usando um modelo de linguagem grande (LLM). A seguir, 3D IA generativa cria uma representação de malha digital do objeto e um algoritmo de voxelização divide a malha 3D em componentes de montagem.

Depois disso, o processamento geométrico modifica a montagem gerada pela IA para levar em conta a fabricação e as restrições físicas associadas ao mundo actual. Isso inclui o número de componentes, saliências e conectividade da geometria.

Isto é seguido pela criação de uma solução viável conjunto planejamento de sequência e caminho automatizado para o braço robótico montar objetos físicos a partir de solicitações do usuário.

Ao utilizar linguagem pure, o sistema torna o design e a fabricação mais acessíveis para pessoas sem experiência em modelagem 3D ou programação robótica, afirmou a equipe do MIT. E, ao contrário da impressão 3D, que pode levar horas ou dias, este sistema pode montar objetos em minutos.

“Este projeto é uma interface entre humanos, IA e robôs para co-criar o mundo que nos rodeia”, disse Kyaw. “Think about um cenário em que você diz ‘Quero uma cadeira’ e, em cinco minutos, uma cadeira física se materializa na sua frente.”

Kyaw planeja fazer melhorias no sistema

Exemplos de objetos construídos por um braço robótico em resposta a comandos de voz como ‘uma prateleira com duas camadas’ e ‘Quero um cachorro alto’. | Fonte: Alexander Kyaw, MIT

A equipe do MIT disse que tem planos imediatos para melhorar a capacidade de suporte de peso dos móveis, mudando a forma de conectar os cubos, de ímãs para conexões mais robustas.

“Também desenvolvemos pipelines para converter estruturas de voxel em sequências de montagem viáveis para aplicações pequenas e distribuídas. robôs móveiso que poderia ajudar a traduzir este trabalho para estruturas de qualquer tamanho”, disse Smith.

A equipe usou componentes modulares para eliminar o desperdício envolvido na fabricação de objetos físicos, desmontando-os e depois remontando-os em algo diferente. Por exemplo, eles poderiam transformar um sofá em uma cama quando o usuário não precisar mais do sofá.

Porque Kyaw também tem experiência usando reconhecimento de gestos e realidade aumentada para interagir com robôs no processo de fabricação, ele está atualmente trabalhando na incorporação da fala e do controle gestual no sistema de fala para realidade. Kyaw disse que foi inspirado por os replicadores do Jornada nas Estrelas franquia e os robôs no filme de animação Grande herói 6.

“Quero aumentar o acesso das pessoas à fabricação de objetos físicos de maneira rápida, acessível e sustentável”, disse ele. “Estou trabalhando para um futuro onde a própria essência da matéria esteja verdadeiramente sob seu controle. Um futuro onde a realidade possa ser gerada sob demanda.”

A equipe apresentou seu papel“Fala para a realidade: produção sob demanda usando linguagem pure, IA generativa 3D e montagem robótica discreta”, no Simpósio sobre Fabricação Computacional da Affiliation for Computing Equipment (ACM) realizado no MIT em 21 de novembro.