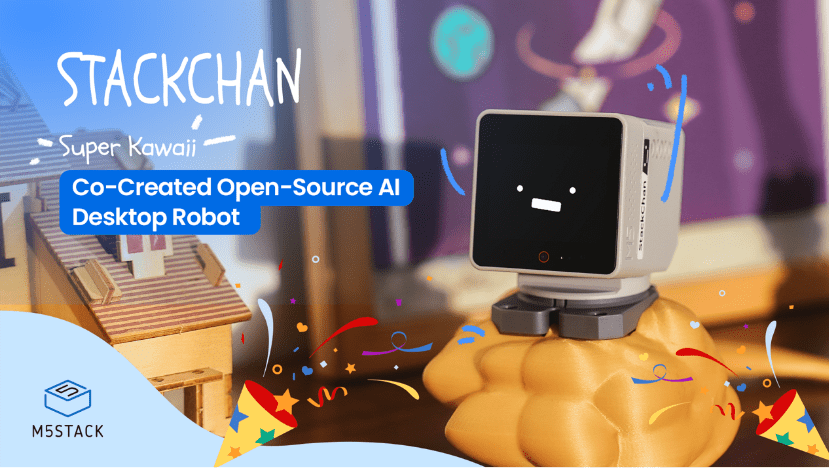

Janeiro de 2026 — M5Stack, líder international em IoT modular e plataformas de desenvolvimento incorporadas, lançou hoje o StackChan, o primeiro robô de desktop de IA de código aberto co-criado pela comunidade, construído em uma plataforma ESP32 comprovada e projetado para ser infinitamente hackeável por fabricantes de todo o mundo.

Ao contrário dos robôs de IA fechados e orientados por conceito, StackChan expõe seu {hardware}, firmware e lógica de interação desde o primeiro dia – transformando um divertido companheiro de desktop em uma verdadeira plataforma de desenvolvimento.

StackChan agora está ativo Kickstarter com uma oferta Tremendous Early Hen de $ 65 disponível nas primeiras 72 horas.

Da comunidade para o globo: como nasceu o StackChan

Antes de seu lançamento oficial pelo M5Stack, StackChan já existia como um projeto conduzido pela comunidade desde 2021. Construído no controlador padrão M5Stack, série Core, começou como um projeto pessoal de código aberto do fabricante Shinya Ishikawa, sustentado e moldado por meio de contribuições contínuas da comunidade.

À medida que mais entusiastas se juntaram ao projeto, colaboradores como Takao, que ajudou a popularizar os kits DIY, e Robo8080, que introduziu recursos de IA, desempenharam papéis importantes na expansão do StackChan além de sua forma authentic.

Inspirado na capacidade de expansão e potencial criativo do StackChan, o M5Stack oficialmente deu vida ao projeto como seu primeiro robô de desktop pronto para jogar, mas infinitamente hackeável, mantendo seu espírito voltado para a comunidade no centro.

O que resta: capacidades básicas de computação e interação

Tal como acontece com a versão authentic, StackChan continua a usar o carro-chefe M5Stack Core Sequence (NúcleoS3) como seu controlador principal. CoreS3 é alimentado por um SoC ESP32-S3 com processador dual-core de 240 MHz, 16 MB Flash e 8 MB PSRAM e suporta conectividade Wi-Fi e BLE.

Para permitir interações mais ricas, a unidade principal integra um show contact capacitivo de 2,0 polegadas, uma câmera de 0,3 MP, um sensor de proximidade, um IMU de 9 eixos (acelerômetro + giroscópio + magnetômetro). Ele também inclui um slot para cartão microSD, um alto-falante de 1 W, microfones duplos e botões liga / desliga. Juntos, esses componentes de {hardware} formam uma base sólida para as experiências interativas audiovisuais do StackChan.

Para obter mais detalhes técnicos, consulte a documentação do StackChan: https://docs.m5stack.com/en/StackChan

O que há de novo: funções prontas para jogar com {hardware} avançado

Para o corpo do robô, vários avanços foram feitos para facilitar a prática e melhorar a experiência imediata. Possui:

Potência e conectividade: Uma interface USB-C para alimentação e dados, combinada com uma bateria integrada de 700 mAh.

Sistema de movimento: 2 servos de suggestions que suportam rotação contínua de 360° no eixo horizontal e inclinação vertical de 90° — permitindo movimentos expressivos com suggestions de posição em tempo actual.

Suggestions visible: 2 linhas totalizando 12 LEDs RGB para sistema expressivo e suggestions de interação.

Sensores e interação: Transmissão e recepção infravermelha, um painel de toque de três zonas e um módulo NFC completo que permite interações baseadas em toque e identidade.

Do lado do software program, StackChan está pronto para ser usado para iniciantes, sem necessidade de codificação. O firmware de fábrica pré-instalado oferece:

Rostos e movimentos expressivos: Pré-carregado com expressões faciais vívidas e movimentos coordenados que trazem personalidade e vivacidade ao StackChan.

Agente de IA integrado: Integra um agente de IA para interação pure baseada em voz e experiências de conversação.

Interação remota baseada em aplicativo: Suporta aplicativo iOS oficial para videochamadas, controle remoto de avatar e interação em tempo actual com StackChan.

Mapa de amigos Chan-to-Chan: Permite a descoberta de dispositivos StackChan próximos, desbloqueando cenários divertidos de interação social e de vários dispositivos.

Aberto para personalização: Embora seja amigável para iniciantes por padrão, o firmware suporta desenvolvimento adicional by way of Arduino e UiFlow2, facilitando a criação de aplicativos personalizados.

100% de código aberto: desenvolvido para ser personalizado e ampliado

Em uma period repleta de produtos de “robôs de IA” fechados e baseados em conceitos, StackChan se destaca por seu núcleo de código aberto. Desde interfaces de firmware e {hardware} até ferramentas de desenvolvimento, cada camada é projetada para ser explorada, modificada e estendida pelos usuários.

Além do código, StackChan também incentiva a personalização física. Com impressão 3D e acessórios criativos, os usuários podem personalizar a aparência do StackChan e transformá-lo em um companheiro exclusivo de desktop.

Repositório de código aberto: https://github.com/m5stack/StackChan

Diversão com a comunidade international: compartilhe, amplie e evolua juntos

Desde o seu nascimento, StackChan cresceu e se tornou uma vibrante comunidade international de criadores, desenvolvedores e entusiastas. Desde o compartilhamento de projetos e código-fonte on-line até a realização de encontros e eventos de aniversário off-line, a comunidade continua a expandir o que o StackChan pode ser.

Possuir um StackChan não se trata apenas de construir um robô – trata-se de fazer parte de um ecossistema aberto onde ideias e criatividade evoluem juntas.

StackChan não foi desenvolvido até o fim no lançamento. Ele foi criado para crescer – por meio de tecnologia aberta, experimentação criativa e uma comunidade international que continua a redefinir o que um robô de mesa pode ser.

Descubra seu StackChan no Kickstarter agora: https://www.kickstarter.com/tasks/m5stack/stackchan-the-first-co-created-open-source-ai-desktop-robot?ref=d5iznw&utm_source=PR

Ähnliche Beiträge