(Eqroy/Shutterstock)

A Lei da IA da União Europeia atingiu outro estágio de execução no fim de semana que afetará a maneira como as empresas podem construir e implementar sistemas de IA que afetam ou são usados pelos residentes europeus.

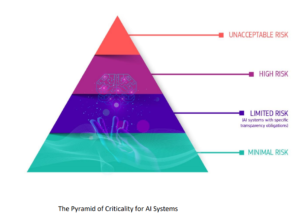

Isso é já foi um ano Desde que o novo ato de IA da UE entrou em vigor. A primeira etapa da aplicação da lei – que foi proposta pela primeira vez pela Comissão Europeia em 2021 e foi formalmente aprovado Em março de 2024 –começou em fevereiro de 2025. Ele proibiu certos usos da IA considerados como tendo riscos inaceitáveis, como a coleta de imagens faciais da Web ou da TV em circuito fechado.

Em 2 de agosto, começou a segunda fase da aplicação, que introduz dois requisitos principais. A primeira é a exigência de que todos os Estados -Membros da UE estabeleceram suas autoridades nacionais para fornecer notificação e vigilância. O segundo requisito é o começo da aplicação dos regulamentos relativos aos modelos de IA (GPAI) de “objetivo geral”, que incluem modelos de idiomas e sistemas de visão computacional.

A Lei da IA possui vários requisitos para os modelos GPAI, incluindo a divulgação de dados de treinamento e licenças de uso. Isso significa que os provedores de modelos GPAI devem fornecer um resumo detalhado do conteúdo usado para treinar o modelo, bem como a prova de consentimento das pessoas que geraram os dados de treinamento. Para os modelos GPAI medidos para representar “risco sistêmico”, os provedores de modelos devem mostrar como estão avaliando os modelos, como estão mitigando o risco e relatam qualquer incidente grave.

“As fontes usadas para treinar um modelo de IA de uso geral que são disponibilizadas para os usuários na Europa terão que ser claramente documentadas”, Thomas Regnier, porta-voz da Comissão Europeia, disse à França24. “Se eles estiverem protegidos por direitos autorais, os autores terão que ser remunerados e, acima de tudo, seu consentimento terá que ser obtido”.

A aplicação deve começar para quaisquer novos modelos GPAI colocados em produção após 2 de agosto de 2025. Para modelos GPAI que já estão em produção – como aqueles de gigantes de tecnologia dos EUA Google, o Google, OpenaiMeta e Antrópico bem como empresa de IA européia Mistral–A Comissão Europeia está fornecendo um período de carência de mais um ano antes do início da execução. As falhas em aderir à nova lei podem incorrer em multas variando de 7,5 milhões de euros (cerca de US $ 8,1 milhões) ou 1% da rotatividade até 35 milhões de euros (cerca de US $ 38 milhões) ou 7% da receita international. Essas multas estão agora em vigor.

Para incentivar a conformidade, a Comissão Europeia publicou no mês passado Código de prática da UE AIuma declaração destinada a ajudar as empresas a cumprir as obrigações da Lei de IA sobre questões de segurança, transparência e direitos autorais. Muitos gigantes de tecnologia dos EUA e empresas europeias de IA assinaram, enquanto outras não. Google assinou, mas não sem reservas.

“… (W) permanecendo preocupados com o fato de a Lei da IA e o código o risco de diminuir o desenvolvimento e a implantação da IA da Europa”, a empresa escreveu em uma postagem no weblog. “Em specific, os afastamentos da lei de direitos autorais da UE, etapas que lentamente aprovações ou requisitos que expõem os segredos comerciais podem relaxar o desenvolvimento e a implantação dos modelos europeus, prejudicando a competitividade da Europa”.

Pai do Fb Meta disse que não assinará o código de prática da IA. “A Europa está seguindo o caminho errado na IA”, Joel Kaplan, chefe do escritório de assuntos globais da Meta, escreveu no LinkedIn. “Analisamos cuidadosamente o Código de Prática da Comissão Europeia para os modelos de IA (GPAI) de uso geral (GPAI) e a Meta não estará assinando”.

A próxima fase da aplicação envolverá os chamados sistemas de IA de alto risco, que a Comissão Europeia descreve como sistemas de IA usados em áreas como aplicação da lei, educação, infraestrutura crítica e pontuação de crédito. As organizações que implantam esses tipos de sistemas precisarão tomar precauções extras antes que possam implantá -las, como a realização de uma avaliação de risco para determinar se violarem os direitos fundamentais, fornecer monitoramento de sistemas, manter registros desses sistemas de IA e garantir que a equipe de suporte seja treinada.

Itens relacionados:

Cinco perguntas à medida que a Lei da AI da UE entra em vigor

A UE vota na lei em lei, com a execução começando no last de 2024

Os formuladores de políticas europeias aprovam as regras para a IA Act