Drone dirigido pela IA da Universidade de Klagenfurt usa Ids ueye Câmera para navegação em tempo actual e relativa a objetos-abordando inspeções mais seguras, eficientes e precisas.

A inspeção de infraestruturas críticas, como usinas de energia, pontes ou complexos industriais, é essencial para garantir sua segurança, confiabilidade e funcionalidade de longo prazo. Os métodos tradicionais de inspeção sempre exigem o uso de pessoas em áreas difíceis de acessar ou arriscadas. Os robôs móveis autônomos oferecem grande potencial para tornar as inspeções mais eficientes, mais seguras e precisas. Veículos aéreos Uncrewed (UAVs), como drones, em explicit, foram estabelecidos como plataformas promissoras, pois podem ser usadas com flexibilidade e podem até alcançar áreas difíceis de acessar do ar. Um dos maiores desafios aqui é navegar pelo drone com precisão em relação aos objetos a serem inspecionados, a fim de capturar de maneira confiável dados de imagem de alta resolução ou outros dados do sensor.

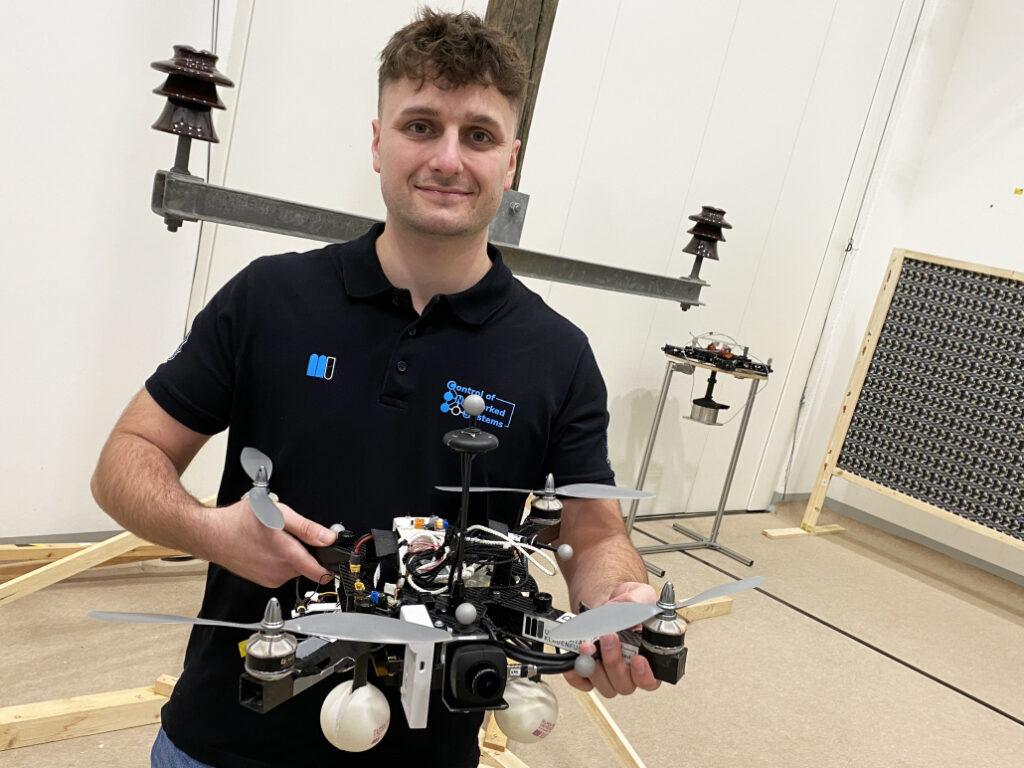

Um grupo de pesquisa da Universidade de Klagenfurt projetou um drone capaz em tempo actual baseado em navegação por objetos, usando inteligência synthetic. Também a bordo: uma câmera industrial de visão USB3 da família UEYE LE da IDS Imaging Growth Programs GmbH.

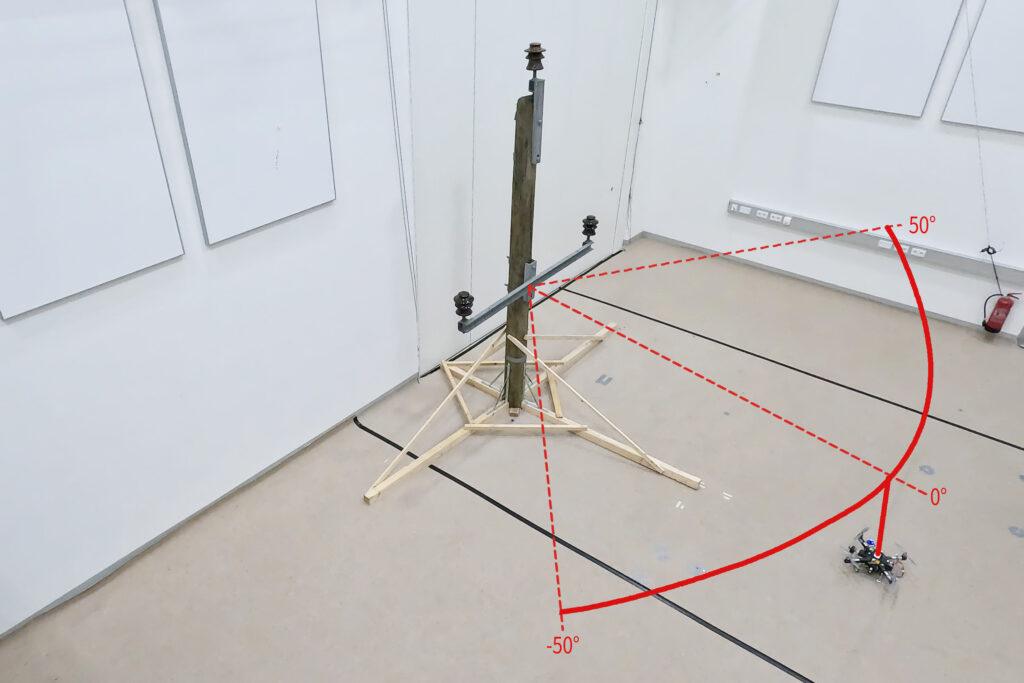

Como parte do projeto de pesquisa, financiado pelo Ministério Federal Austríaco para Ação Climática, Meio Ambiente, Energia, Mobilidade, Inovação e Tecnologia (BMK), o drone deve reconhecer autonomamente o que é um Energy Pólo e o que é um isolador no Energy Pólo. Ele voará ao redor do isolador a uma distância de três metros e tirará fotos. „Localização precisa é importante de modo que as gravações da câmera também possam ser comparadas em vários voos de inspeção”, explica Thomas Georg Jantos, estudante de doutorado e membro do controle do grupo de pesquisa de sistemas em rede da Universidade de Klagenfurt. O pré-requisito para isso é que a navegação relativa a objetos deve ser capaz de extrair as chamadas informações semânticas sobre os objetos em questão dos dados sensoriais brutos capturados pela câmera. As informações semânticas tornam os dados brutos, neste caso as imagens da câmera, “compreensíveis” e possibilitam não apenas capturar o ambiente, mas também identificar e localizar corretamente objetos relevantes.

Nesse caso, isso significa que um pixel de imagem não é entendido apenas como um valor de cor independente (por exemplo, valor RGB), mas como parte de um objeto, por exemplo, um isolador. Em contraste com os GNNs clássicos (sistema world de satélite de navegação), essa abordagem não apenas fornece uma posição no espaço, mas também uma posição relativa e orientação precisa em relação ao objeto a ser inspecionado (por exemplo, „Drone está localizado 1,5m à esquerda do isolador superior”).

O requisito principal é que o processamento da imagem e a interpretação dos dados devem ser livres de latência, para que o drone possa adaptar sua navegação e interação às condições e requisitos específicos da tarefa de inspeção em tempo actual.

Informações semânticas através de processamento de imagem inteligente

O reconhecimento de objetos, a classificação e a estimativa de pose de objetos são realizados usando a inteligência synthetic no processamento de imagens. „Em contraste com as abordagens de inspeção baseadas em GNSS usando drones, nossa IA com suas informações semânticas permite que a inspeção da infraestrutura seja inspecionada a partir de certos pontos de vista reprodutíveis”, explica Thomas Jantos. „Além disso, a abordagem escolhida não sofre com os problemas usuais de GNSS, como multi-pathing e sombreamento causados por grandes infraestruturas ou vales, o que pode levar à degradação e, portanto, a riscos de segurança.“

Quanto a IA se encaixa em um pequeno quadcopter?

A configuração de {hardware} consiste em uma plataforma de Copter Science Twins equipada com um piloto automático Pixhawk PX4, um Nvidia Jetson Orin AGX 64GB Devkit como computador a bordo e uma câmera industrial USB3 Imaginative and prescient da IDS. „O desafio é colocar a inteligência synthetic para os pequenos helicópteros.

Os computadores no drone ainda são muito lentos em comparação com os computadores usados para treinar a IA. Com os primeiros testes de sucesso, este ainda é objeto de pesquisa atual, “diz Thomas Janto, descrevendo o problema de otimizar ainda mais o modelo de IA de alto desempenho para uso no computador a bordo.

A câmera, por outro lado, fornece dados básicos perfeitos imediatamente, como os testes no próprio present de drones da universidade. Ao selecionar um modelo de câmera adequado, não period apenas uma questão de atender aos requisitos em termos de velocidade, tamanho, classe de proteção e, por último, mas não menos importante, preço. “Os recursos da câmera são essenciais para o inovador algoritmo de navegação baseado em IA do sistema de inspeção”, diz Thomas Jantos. Ele optou pelo modelo C-HQ U3-3276LE, uma câmera de projeto que economiza espaço e econômica da família Ueye Le. O sensor integrado da Sony Pregius IMX265 é provavelmente o melhor sensor de imagem CMOS na classe de 3 MP e permite uma resolução de 3,19 megapixels (2064 x 1544 px) com uma taxa de quadros de até 58,0 fps. O obturador world integrado de 1/1,8 “, que não produz imagens distorcidas nesses tempos de exposição curtos em comparação com um obturador rolante, é decisivo para o desempenho do sensor. „Para garantir um voo de inspeção seguro e robusto, a alta qualidade da imagem e as taxas de quadros são essenciais”, enfatiza Thomas Jantos. Como uma câmera de navegação, o UEYE LE fornece à IA incorporada os dados de imagem abrangentes que o computador a bordo precisa para calcular a posição relativa e a orientação em relação ao objeto a ser inspecionado. Com base nessas informações, o drone é capaz de corrigir sua pose em tempo actual.

A câmera IDS está conectada ao computador a bordo por meio de uma interface USB3. „Com a ajuda do IDS Peak SDK, podemos integrar a câmera e suas funcionalidades com muita facilidade no ROS (sistema operacional robô) e, portanto, em nosso drone”, explica Thomas Janto. O IDS Peak também permite processamento de imagem bruta eficiente e ajuste simples de parâmetros de gravação, como exposição automática, balanceamento branco automático, ganho automático e redução de imagem de imagem.

Para garantir um alto nível de autonomia, controle, gerenciamento de missões, monitoramento de segurança e gravação de dados, os pesquisadores usam a pilha de voo do CNS disponível para fonte no computador a bordo. A pilha de vôo do CNS inclui módulos de software program para algoritmos de navegação, fusão de sensores e controle e permite a execução autônoma de missões reproduzíveis e personalizáveis. „A modularidade da pilha de voo do CNS e das interfaces de rosas nos permitem integrar perfeitamente nossos sensores e o ‘estimador de estado’ baseado em IA para detecção de posição em toda a pilha e, assim, realizar vôos autônomos de UAV.

Alinhamento preciso e autônomo através da fusão do sensor

Os sinais de controle de alta frequência para o drone são gerados pela IMU (unidade de medição inercial). A fusão do sensor com dados da câmera, LIDAR ou GNSS (sistema world de satélite de navegação) permite a navegação e a estabilização em tempo actual do drone-por exemplo, para correções de posição ou alinhamento preciso com objetos de inspeção. Para o drone Klagenfurt, o IMU do PX4 é usado como um modelo dinâmico em um EKF (filtro Kalman estendido). O EKF estima onde o drone deve agora se basear na última posição, velocidade e atitude conhecidas. Novos dados (por exemplo da IMU, GNSS ou câmera) são registrados em até 200 Hz e incorpidos no processo de estimativa do estado.

A câmera captura imagens cruas a 50 fps e um tamanho de imagem de 1280 x 960px. „Esta é a taxa máxima de quadros que podemos alcançar com nosso modelo de IA no computador a bordo do drone”, explica Thomas Janto. Quando a câmera é iniciada, um equilíbrio de branco automático e ajuste de ganho são realizados uma vez, enquanto o controle automático de exposição permanece desligado. A EKF compara a previsão e medição e corrige a estimativa de acordo. Isso garante que o drone permaneça estável e possa manter sua posição autonomamente com alta precisão.

Panorama

„Com relação à pesquisa no campo dos robôs móveis, as câmeras industriais são necessárias para uma variedade de aplicações e algoritmos. É importante que essas câmeras sejam robustas, compactas, leves, rápidas e tenham uma alta resolução. A pré-processamento no gadget.

Com os recursos correspondentes, as câmeras IDs estão ajudando a definir um novo padrão na inspeção autônoma de infraestruturas críticas nessa abordagem promissora de pesquisa, o que aumenta significativamente a segurança, a eficiência e a qualidade dos dados.

O Controle de Sistemas de Rede (CNS) Grupo de Pesquisa faz parte do Instituto de Tecnologias de Sistemas Inteligentes. Está envolvido no ensino dos programas de bacharel em inglês e mestrado “Robotics and AI” e “Engenharia de Informações e Comunicações (ICE)” na Universidade de Klagenfurt. A pesquisa do grupo se concentra na engenharia de controle, estimativa de estado, planejamento de caminho e movimento, modelagem de sistemas dinâmicos, simulações numéricas e automação de robôs móveis em um enxame: Mais informações

Modelo usado:USB3 Imaginative and prescient Industriekamera U3-3276LE Rev.1.2

Família de câmeras: ueye le

Direitos da imagem: Alpen-Adria-Universität (aau) Klagenfurt

© 2025 IDS Imaging Growth Programs GmbH

Ähnliche beiträge